La plataforma de redes sociales, Meta, ha anunciado recientemente una serie de nuevas medidas destinadas a hacer de su aplicación un espacio más seguro para los usuarios, especialmente los más jóvenes. Con el objetivo de crear un ambiente más responsable y adecuado para los padres, Meta ha introducido notificaciones automáticas, filtros de contenido, herramientas de gestión del tiempo y nuevos mecanismos para proteger a los creadores. Sin embargo, estas iniciativas han sido cuestionadas y se ha iniciado una investigación en Italia por posible abuso de posición al integrar su inteligencia artificial en WhatsApp.

La llegada de la tecnología y las redes sociales han traído consigo una serie de beneficios, como la facilidad de comunicación y acceso a información. Sin embargo, también han surgido nuevos desafíos, especialmente en lo que respecta a la protección de la privacidad y la seguridad de los usuarios. Esto se ha vuelto aún más preocupante preciso a la creciente afluencia de menores de edad en estas plataformas.

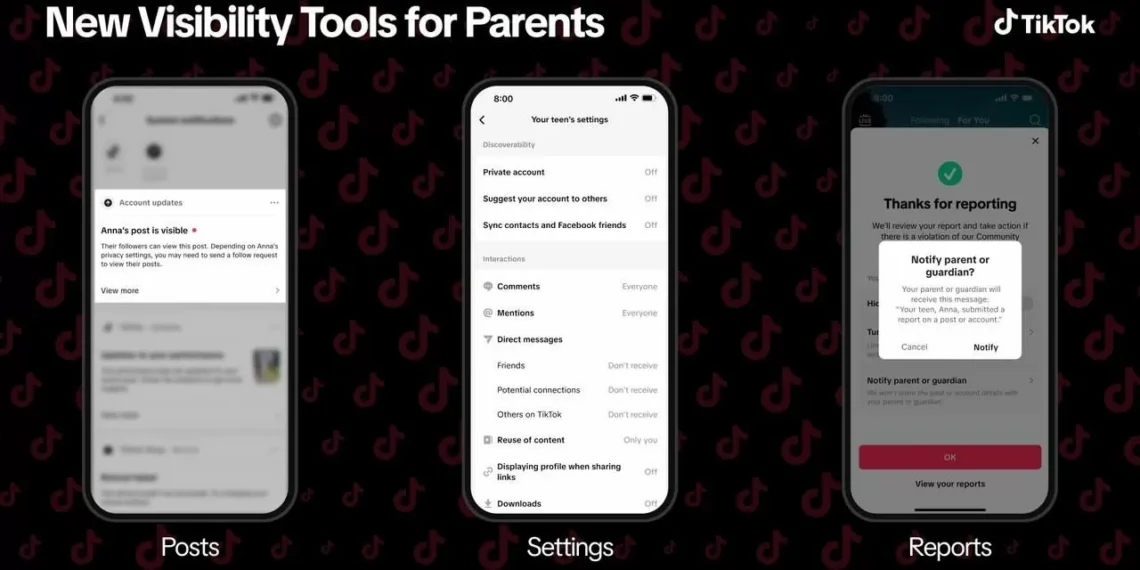

Consciente de esta realidad, Meta ha tomado una serie de medidas proactivas para resignarse estas preocupaciones y garantizar un entorno más seguro para sus usuarios. A través de notificaciones automáticas, los padres podrán recibir alertas sobre la actividad de sus hijos en la aplicación, incluyendo mensajes, publicaciones y fotos. Esto les permitirá estar más al tanto de lo que sus hijos están haciendo en línea y tomar las medidas necesarias en caso de que se detecten comportamientos inapropiados.

Además, Meta ha implementado filtros de contenido que ayudarán a bloquear y filtrar contenido inapropiado para los usuarios menores de edad. Estos filtros se basan en la edad y la ubicación de los usuarios y serán aplicados automáticamente, sin necesidad de que los padres realicen ajustes manuales. Esto ayudará a proteger a los niños de ser expuestos a contenido inapropiado.

Otra herramienta importante que se ha introducido es la gestión del tiempo. Los padres podrán establecer límites de tiempo para el uso de la aplicación por parte de sus hijos, lo que les permitirá controlar mejor el tiempo que pasan en línea y promover un uso más saludable de la aplicación. Además, Meta también ha implementado un nuevo mecanismo de protección para los creadores, que les permitirá controlar quién puede ver y compartir su contenido. Esto ayudará a prevenir la difusión de contenido no deseado y proteger la privacidad de los usuarios.

Estas medidas, anunciadas por Meta, han sido recibidas con entusiasmo por parte de los padres y defensores de la seguridad en línea. Sin embargo, también han surgido preocupaciones sobre la integración de la inteligencia artificial de Meta en otras aplicaciones, específicamente WhatsApp. Las autoridades en Italia han iniciado una investigación sobre un posible abuso de posición por parte de Meta al integrar su IA en WhatsApp, lo que podría darle una ventaja injusta sobre otras empresas en el mercado.

A pesar de estas preocupaciones, es importante reconocer que las medidas tomadas por Meta son un paso en la dirección correcta para garantizar la seguridad y protección de los usuarios en línea, especialmente los más jóvenes. Es responsabilidad de las empresas de tecnología tomar medidas proactivas para resignarse los desafíos en línea y garantizar un ambiente más seguro para todos.

En resumen, Meta ha demostrado su compromiso con la seguridad en línea mediante la implementación de nuevas medidas para proteger a los usuarios y promover un uso responsable de su aplicación. Las notificaciones automáticas, filtros de contenido, herramientas de gestión del tiempo y mecanismos de protección para los creadores son un paso importante hacia un entorno en línea más seguro y responsable. Esperamos que otras empresas sigan el ejemplo de Meta y trabajen en conjunto para garantizar una experiencia en línea positiva y segura para todos.